Op 4 januari van dit jaar vindt er een boeiende confrontatie plaats op YouTube. De populaire Amerikaanse YouTuber Andy Warski (258.000 abonnees) is gastheer van een felle live discussie tussen Richard Spencer, Sargon of Akkad en Styxhexenhamer666.

Spencer is een beruchte Amerikaanse neonazi, die na de verkiezing van Trump nationale bekendheid kreeg vanwege video’s waarin hij ‘hail Trump’ roept in een zaal vol neonazi’s en nadat hij op live tv een klap voor zijn bakkes kreeg van een antifascist.

Sargon of Akkad is de populaire Britse YouTuber Carl Benjamin (853.000 abonnees). Hij is een antifeminist en wordt vaak gerekend tot de Amerikaanse extreemrechtse alt-rightbeweging, of schurkt daar in ieder geval dicht tegenaan.

Styxhexenhammer666 is de Amerikaanse YouTuber Tarl Warwick (294.000 abonnees), die zichzelf libertariër noemt, maar eveneens wordt geschaard onder de alt-right.

Warski heeft deze beruchte mannen online bij elkaar gebracht om 4,5 (!) uur te discussiëren, over feminisme, identiteitspolitiek en, een stokpaardje van Spencer, het verwezenlijken van een witte etnostaat. Ondanks de taaie onderwerpen en de lange duur trekt de uitzending meer dan een half miljoen kijkers en worden er meer dan 21.000 reacties geplaatst.

Een fascinerende discussie

Als je door die comments heen gaat, is het duidelijk wie het debat heeft gewonnen: de eloquente en intelligente neonazi Richard Spencer.

Het is in allerlei opzichten een fascinerende discussie:

- Het steekspel is oprecht interessant om te bekijken. De sprekers zijn niet dom, zoveel is wel duidelijk.

- Het format is spannend. Niet voor niets wordt dit format ook wel ‘blood sports’ genoemd. Het is hard tegen hard.

- Van de interactie met de kijkers kunnen nog veel reguliere programma’s leren. Bijna de helft van de zendtijd gaat op aan het beantwoorden van kijkersvragen, die in de ‘superchat’, een reactieservice op YouTube waar reaguurders voor moeten betalen, opduiken.

- Dat een beruchte neonazi zo uitgebreid zijn gedachten uit de doeken mag doen, is opmerkelijk. Dat zo iemand als winnaar uit de bus komt en zieltjes kan winnen onder zo’n groot kijkerspubliek, was tot een paar jaar geleden volstrekt ondenkbaar.

- En, interessant, YouTube verdient hier geld aan. Een deel van de opbrengsten – hoeveel is niet bekend – van de betaalde reacties in de superchat gaat immers naar YouTube.

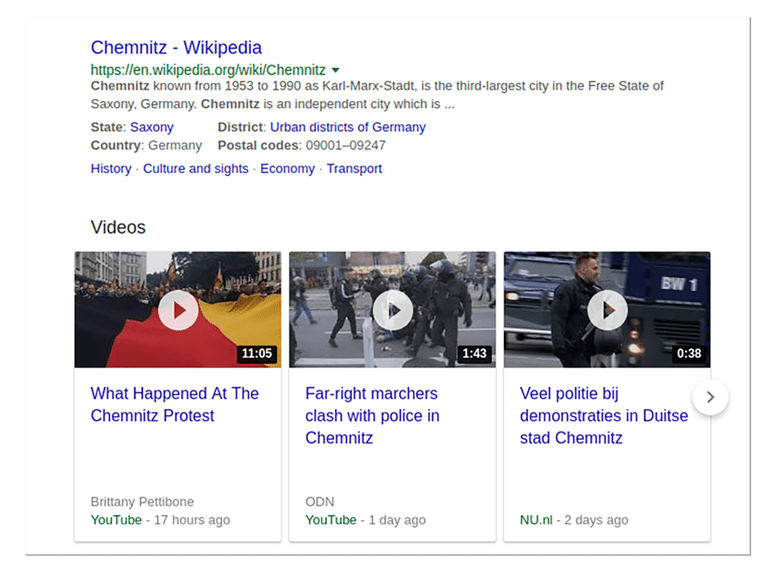

Dit soort video’s zijn geen uitzondering op YouTube. Wie op zoek is naar extreme content, heeft snel resultaat. Onlangs nog zocht ik informatie over de rellen in Chemnitz. Dit was het resultaat.

De eerst aanbevolen video is van Brittany Pettibone, een bekende alt-right YouTuber die vanwege haar denkbeelden het Verenigd Koninkrijk niet meer in mag. Dit soort content concurreert dus succesvol op YouTube met mainstream nieuws.

Hoe kan dit? En wat gebeurt er allemaal nog meer op ’s werelds populairste videoplatform en het medium dat door jongeren het meest gebruikt wordt?

Hoe krijg je vat op die informatiebubbels?

Ik ben al een paar maanden bezig om enkele extreme bubbels op YouTube beter te leren begrijpen. Dit stuk is bedoeld om je even bij te praten over wat ik met een groot team van vrijwilligers de afgelopen tijd heb gedaan. Het werk is nog vrij technisch tot nu toe. We schrijven een reeks van programma’s en ontwikkelen een methodologie om niet alleen de extreemrechtse bubbel in kaart te brengen en te analyseren, maar dat ook te doen met andere informatiebubbels (zoals de extreemlinkse).

We laten ons leiden door drie vragen:

- Wat is de aard van extremistische informatiebubbels? Wat voor video’s worden daar gemaakt en door wie, in hoeverre vormen ze een gemeenschap, hoe voorzien ze in hun onderhoud, wat zijn de motieven van de makers en hoe proberen zij hun doelen te bereiken?

- Hoe worden gebruikers van YouTube naar dit soort informatiebubbels getrokken of geduwd? Hoe komen ze daar terecht en hoe blijven ze daar?

- Wat zijn de gevolgen van dit soort content op de gebruikers?

Deze vragen zijn niet met data alleen te beantwoorden, vooral de laatste niet. Daarom doen we ook veel aanvullend onderzoek, zoals het interviewen van gebruikers en experts, en kijken we natuurlijk ook naar het wetenschappelijk onderzoek hiernaar (al is dat tot dusver vrij weinig).

Op dit moment hebben we deze data vergaard, bij elkaar zo’n 50 gigabyte:

- Een lijst met circa duizend kanalen die je mogelijk als rechts-extremistisch zou kunnen bestempelen, en circa tweeduizend kanalen aan de linkerkant. Deze data moeten nog goed gefilterd worden en dat is een continu proces (waarover straks meer).

- Een lijst van 300.000 video’s die op deze kanalen te vinden zijn, met metadata, dus titels, beschrijvingen, likes, dislikes, kijkcijfers, duur, uploaddatum en nog veel meer.

- De bijbehorende aanbevolen video’s. Per video kijken we welke andere video’s volgens YouTube gerelateerde content hebben. Die aanbevelingen duiken op in het lijstje aan de rechterkant van je scherm als je YouTube gebruikt.

- Van circa 130.000 video’s hebben we de transcripties kunnen downloaden. Als je een video opstart, kun je er vaak voor kiezen om de ondertiteling mee te laten lopen. Die wordt automatisch gegenereerd. Door een foefje zijn we erin geslaagd om van ongeveer de helft van alle video’s die transcripties te downloaden.

- En we hebben alle reacties op alle video’s gedownload (honderdduizenden).

Vooral die transcripties zijn een godsgeschenk, want die verlossen ons van een groot probleem, want wat noem je extremistisch? Bij een neonazi als Richard Spencer is dat vrij duidelijk. Of, hier in Nederland, het kanaal van de Nederlandse Volks-Unie of Erkenbrand.

Maar hoe moeten we Sargon of Akkad classificeren? Of, dichter bij huis, de kanalen van populistische partijen die soms dicht tegen de extremen aanschurken, maar vaak ook weer niet? Plus: onze data gaan terug tot 2007. Sommige kanalen zijn in die tijd milder geworden, andere juist weer extremer.

Het handmatig classificeren van de gevonden kanalen was daarom een heilloze weg.

De oplossing: geautomatiseerde tekstanalyse

Begin september hebben we daarom een hackathon gehouden om manieren te vinden om al die data te kunnen ontsluiten. Er kwamen twintig deelnemers op af, en een groepje slaagde erin om op basis van die transcripties geautomatiseerd de onderwerpen van de video’s te destilleren. Dit is natural language processing, het geautomatiseerd herkennen van betekenis in taal.

De eerste resultaten zien er goed uit en stellen ons in staat om per kanaal en over de tijd de onderwerpen te achterhalen waarover in die duizenden en duizenden video’s gesproken wordt. We kunnen laten zien hoe die onderwerpen veranderen door de actualiteit, hoe kanalen zich ontwikkelen en hoe ze zich tot elkaar verhouden (op het gebied van onderwerpen).

Met toevoeging van onze andere data kunnen we dan een goed beeld krijgen van de aard van dit netwerk. We kunnen bijvoorbeeld ook kijken welke kijkersgemeenschappen er zijn, waar ze over praten, onder welke video’s en kanalen ze actief zijn. Waar ik zelf bijvoorbeeld benieuwd naar ben, is hoe reaguurders omgaan met vrouwelijke YouTubers. Die presenteren zichzelf vaak als antifeministisch, maar dat staat voor sommige kijkers weer op gespannen voet met hun werk als prominente opiniemakers.

En zo proberen we een algoritme uit te pluizen

We hebben ook een experiment gedaan waarin we de aanbevelingen van YouTube voor gerelateerde video’s wilden doorgronden. De hypothese, verkondigd in verschillende media, is dat het aanbevelingsalgoritme gebruikers naar die extreme informatiebubbels zuigt door steeds extremere content aan te bieden.

We hebben eerder dit jaar code geschreven die dat kan onderzoeken en een aantal testen gedaan op de computers van lezers en op scholen. De resultaten zijn... lastig. We hebben een aantal concessies moeten doen toen we de code schreven. Zo mocht het programma niet te veel tijd nodig hebben om alle aanbevelingen binnen te halen, maar dat betekende ook dat we minder aanbevelingen konden volgen dan we wilden. Ook lukte het niet om in deze versie een echt gepersonaliseerde zoekervaring na te bootsen, omdat we geen gebruik konden maken van de cookies die YouTube normaliter gebruikt om aanbevelingen zo relevant mogelijk te maken voor jou.

Inmiddels hebben we de code herschreven en kunnen we dat wel. We zijn nog aan het nadenken over hoe we een nieuw, kleiner experiment kunnen inrichten om de hypothese ook op andere manieren te testen.

We hebben dus erg veel gedaan, maar er moeten ook nog wel een paar dingen gebeuren. Op zondag 28 oktober houden we daarom een tweede hackathon om de code voor de tekstanalyse verder te verfijnen, de vergaarde data op te schonen en alles te combineren, zodat we eindelijk een paar van onze vragen kunnen gaan beantwoorden.

Als je het interessant vindt, kun je daarbij zijn. Voorwaarde is wel dat je over goede Python-vaardigheden beschikt, ervaring hebt met natural language processing, zoals topic modelling, en er geen probleem mee hebt om bij een bestaand project aan te haken.

Mocht je mee willen doen, stuur me dan even een mailtje: dimitri at decorrespondent.nl.

Meer lezen?

Trap er niet in: deze grappen zijn eigenlijk extreemrechtse propaganda

Memes lijken onschuldige en grappige plaatjes, maar ze worden óók ingezet als politieke propaganda. Extreemrechtse figuren claimen zelfs dat zij Donald Trump het Witte Huis in hebben ‘gememed’.

Trap er niet in: deze grappen zijn eigenlijk extreemrechtse propaganda

Memes lijken onschuldige en grappige plaatjes, maar ze worden óók ingezet als politieke propaganda. Extreemrechtse figuren claimen zelfs dat zij Donald Trump het Witte Huis in hebben ‘gememed’.

Deze rechts-populistische complottheorie wil maar niet verdwijnen

Eén complottheorie wordt al twintig jaar door media, activisten en politici in leven gehouden: die van een linkse elite die moedwillig moslims Europa binnenlaat om onze beschaving te vernietigen. Waarom is deze theorie zo hardnekkig? Een analyse van de drie gangbare varianten.

Deze rechts-populistische complottheorie wil maar niet verdwijnen

Eén complottheorie wordt al twintig jaar door media, activisten en politici in leven gehouden: die van een linkse elite die moedwillig moslims Europa binnenlaat om onze beschaving te vernietigen. Waarom is deze theorie zo hardnekkig? Een analyse van de drie gangbare varianten.

De zaak ‘Pizzagate’ – of hoe nepnieuws en complottheorieën hun weg vinden naar een breed publiek

Het geweersalvo dat een Hillary Clinton-hater eind 2016 afvuurde in een pizzeria in Washington laat zien hoe nepnieuws en zelfs de meest bizarre complottheorieën weerklank vinden bij een breed publiek. Wie waren verantwoordelijk voor ‘Pizzagate’? Een reconstructie.

De zaak ‘Pizzagate’ – of hoe nepnieuws en complottheorieën hun weg vinden naar een breed publiek

Het geweersalvo dat een Hillary Clinton-hater eind 2016 afvuurde in een pizzeria in Washington laat zien hoe nepnieuws en zelfs de meest bizarre complottheorieën weerklank vinden bij een breed publiek. Wie waren verantwoordelijk voor ‘Pizzagate’? Een reconstructie.

Dit verhaal heb je gratis gelezen, maar het maken van dit verhaal kost tijd en geld. Steun ons en maak meer verhalen mogelijk voorbij de waan van de dag.

Al vanaf het begin worden we gefinancierd door onze leden en zijn we volledig advertentievrij en onafhankelijk. We maken diepgravende, verbindende en optimistische verhalen die inzicht geven in hoe de wereld werkt. Zodat je niet alleen begrijpt wat er gebeurt, maar ook waarom het gebeurt.

Juist nu in tijden van toenemende onzekerheid en wantrouwen is er grote behoefte aan verhalen die voorbij de waan van de dag gaan. Verhalen die verdieping en verbinding brengen. Verhalen niet gericht op het sensationele, maar op het fundamentele. Dankzij onze leden kunnen wij verhalen blijven maken voor zoveel mogelijk mensen. Word ook lid!

/dc-useruploads-images/54ebe274b1414dd58211f9615b03eb0b.png)