De datahonger van staten en bedrijven zet veel meer op het spel dan uw privacy alleen

Er zijn veel bestuurders van ziekenhuizen, scholen en bedrijven die hun processen laten sturen door data omdat dat ‘beter’ is voor de samenleving. Maar volgens wie? Volgens de nieuwe wereldmachten Facebook en Google? Hoog tijd voor een stevig gesprek over het morele karakter van data.

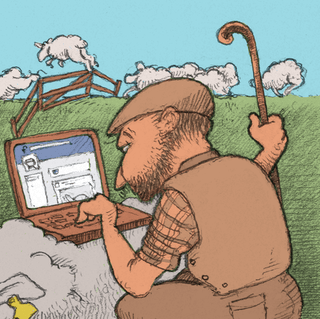

Onlangs verscheen een splinternieuwe aflevering van de Bijbel. De gemeente Leeuwarden besloot een schaapherder de begrazing van 25 hectare grond aan de rand van de stad niet te gunnen, omdat hij niet op Facebook zat. Dit was een administratieve beslissing die moeiteloos in het Nieuwe Testament zou passen.

Zoals u weet begint het evangelie van Lucas met de beschrijving van het administratieve proces dat wij kennen als het Kerstverhaal. Dat verhaal gaat over persoonsregistratie: Jozef en Maria reizen naar Bethlehem omdat keizer Augustus heeft bevolen dat het hele rijk ingeschreven moet worden. Of, zoals de Statenvertaling zegt: ‘Dat de geheele wereld beschreven zouden worden.’

Je kunt zeggen dat de christelijke geschiedschrijving zo begint met de wens tot een grotere bestuurlijke greep op de burgers. Zolang die wild met hun kuddes rond dwalen, zijn ze grotendeels onvindbaar voor het bestuur.

Zoek je bijvoorbeeld in de eerste kersttijd een pasgeboren kind, zoals koning Herodes doet, dan moet je bij de wijzen uit het oosten informatie inwinnen om te weten wie het kind is en waar het zich bevindt. Laten zij wijselijk niets los, dan zit er niets op dan maar meteen alle kinderen ‘binnen Bethlehem en deszelfs landpalen’ te vermoorden, dan weet je zeker dat je het verdachte kind te pakken hebt.

Een sleepnet, noemen de veiligheidsdiensten dat tegenwoordig.

Zelfs overheden zijn niet onverdeeld gelukkig met de methode van zo’n sleepnet. En dus ontstaat de bestuurlijke behoefte burgers preciezer te beschrijven, te traceren, te corrigeren, en daartoe te registreren. In deze ontwikkeling past die nieuwe, eenentwintigste-eeuwse episode van de Bijbel, waarin een schaapherder wordt verplicht een Facebookaccount te openen.

Facebook is namelijk, zoals de naam al verklapt, gericht op persoonstracering en persoonsbeschrijving. Het bedrijf mikt op beschrijving van de gehele wereld: het maakt een biometrische blauwdruk van je gezicht en verkoopt die aan andere bedrijven, het verzamelt je toetsaanslagen en onderzoekt zo hoe je jezelf censureert, het volgt je blikrichting bij het bekijken van video’s, het bestudeert hoe snel je leest, naar wie je kijkt en hoelang, het leest je brieven en vindt je op plekken waar je niet gevonden wilt worden – en al met al is het begrijpelijk dat een overheid interesse toont voor al deze activiteit en kennis van Facebook.

Het is even begrijpelijk dat schaapherders geen zin hebben in een account.

De gezamenlijke greep van overheden en bedrijven op het individuele leven is een proces van rationalisering - en naar de voors en tegens daarvan wil ik hier nauwkeuriger kijken. De tegens van de rationalisering zijn al eeuwenlang bekend; vooral de morele blindheid die erdoor ontstaat, de verloochening van waarden en morele argumenten.

Kunnen we daarvan in het digitale tijdperk misschien iets leren?

Honderd jaar geleden, in 1917, gaf de socioloog Max Weber de lezing Wissenschaft als Beruf. In de betekenis die hij daar aan de term rationalisering gaf, draait alles om ordening, procesdenken en systeemdenken. Weber was kritisch op de pretenties ervan.

Volgens hem leidt toenemende rationalisering in de moderne tijd niet zozeer tot grotere kennis over onze eigen leefwereld, want vrijwel niemand van ons weet hoe de tram werkt, maar wel tot de overtuiging dat je het zou kunnen weten. De gedachte bloeit op dat je het leven en de natuur volledig kunt begrijpen, als je maar wilt, en dat je deze met technische middelen kunt beheersen.

In ons eigen digitale tijdperk denkt de moderne mens het gedrag van de anderen te kunnen voorzien en hun keuzes te kunnen sturen, simpelweg door gegevens te verzamelen over hun blikrichting, hun toetsaanslagen en hun aankoopgedrag. Er zijn geen onoplosbare raadsels, er zijn geen geheimzinnige, onberekenbare machten aan het werk. Alles is beheersbaar. Alles is voorspelbaar.

Zelf opereer ik tegenwoordig met voormalig verkeersvlieger Benno Baksteen in een adviespraktijk onder precies de tegenovergestelde leuze. ‘De echte wereld is fundamenteel onvoorspelbaar,’ roepen wij zonnig. Want natuurlijk zijn wetenschappelijke modellen, protocollen, regelsystemen en andere abstracties onmisbaar – alleen al voor het bouwen van vliegtuigen, het berekenen van vluchten, het stroomlijnen van het luchtverkeer en het regelen van verantwoordelijkheden. Rules are tools, zegt gezagvoerder Baksteen.

De wereld is niet te vangen in abstracties en er zeker niet mee te voorspellen

Maar als je daadwerkelijk over de oceaan vliegt, blijkt de wereld toch altijd net iets rijker dan je vooraf had voorzien: de wereld is niet te vangen in abstracties en er zeker niet mee te voorspellen. Met onze leuze staan we in de moderne traditie van rationaliteitskritiek, die kanttekeningen plaatst bij de pretenties van op regels gebaseerde controle.

Nu is voor de volgende stap even moed nodig. Maar aangezien deze lezing een eerbetoon is aan de Wet van Godwin en er kennelijk iets van me wordt verwacht, durf ik die stap wel te zetten en te beginnen over het boek Modernity and the Holocaust (1989) van Zygmunt Bauman.

Volgens de socioloog Bauman is de Holocaust namelijk een consequentie geweest van datzelfde rationaliseringsproces waarover Weber al in 1917 kritisch schreef. De Holocaust, zegt Bauman, was geen terugval in de barbarij die in de toekomst kan worden voorkomen door ons nog meer en nog sneller te ontwikkelen.

Integendeel: de massamoord was juist een typische verschijningsvorm van de moderniteit. De ‘matter-of-fact efficiency’ waarmee de genocide werd voorbereid, de gebruikte militaire technologie, het wetenschappelijke management van de gehele organisatie: de Holocaust was bij uitstek een prestatie van een moderne, industriële en bureaucratische samenleving.

De misdaden van het naziregime waren dan ook geen oprispingen van de onderbuik of vlagen van verstandsverbijstering. Ze kwamen voort uit de rationalistische misvatting dat het volgen van regels op zich al moreel juist is. Dit verafgoden van de regels leidt tot morele blindheid, want ten gevolge daarvan raakt niet alleen het individu uit zicht, maar verliest het individu zelf ook het zicht op zijn morele verantwoordelijkheid.

Als ik aarzel om me aan deze Godwin te bezondigen en de Holocaust erbij te halen, is het hierom: ik wil niet suggereren dat een overheid alleen al door data te verzamelen bewust op weg gaat naar de Holocaust. Alstublieft, wees zo vriendelijk dat niet in mijn woorden te lezen.

Maar Max Weber en Zygmunt Bauman laten wel zien wat het gevaar kan zijn als het bestuur zijn greep op mens en samenleving versterkt met behulp van managementsystemen en technologieën. Want alleen al het gebruik van zulke beheerstechnieken verandert de manier waarop we naar elkaar en de wereld kijken. En voordat je het weet, doe je dingen die over tien, twintig jaar niet zo verstandig blijken te zijn geweest.

Nu al komen overheden bij iedere stap op de weg met weer een nieuwe bestuurlijke oplossing die nog meer greep belooft – een Facebookaccount voor een schaapherder - en niemand die nog acht slaat op de richting waarin de maatschappij zich beweegt. Niemand die de grote politieke vragen stelt. Wat willen we van het leven? Wat willen we van het samenleven? Bureaucraten en managers kunnen best volhouden dat data-analyses goed zijn voor efficiëntie, maar efficiëntie is niet een goed in zichzelf.

Dit is de schokkende ontdekking van de Europeanen geweest na de Holocaust: dat rationele en wetenschappelijke middelen niet vanzelf het goede dienen en dat ontwikkeling niet altijd vooruitgang is. Ordening, analyse, meting, systematisering – al die middelen kunnen wreed en barbaars uitpakken.

Daarom heeft het bestuur van een land of een onderneming richting nodig, waarden, principes, morele argumenten. Daarom is een politiek gesprek nodig over de bestuurlijke inzet van Facebook, kinddossiers, patiëntendossiers, overheidsachterdeurtjes in software, dataprofielen en andere digitale middelen; een politiek gesprek waarin je het oneens kunt zijn, waarin je over waarden kunt steggelen en tot democratische afwegingen kunt komen.

Die les van de Holocaust is vandaag zeker nog niet geleerd. Dat politieke gesprek is er simpelweg niet. De moderne, rationalistische mens droomt liever van het einde van de politiek en denkt dat je autonoom kunt besturen met de data die Facebook, Philips en Amazon uit belangeloze liefde voor ons verzamelen.

Waarom heeft de moderne mens daarin dan eigenlijk ongelijk?

Laat ik allereerst een anekdote van een ander opdienen. Gerrit-Jan Zwenne, hoogleraar Recht en de Informatiesamenleving te Leiden, vertelt in een interview dat hij bij toeval de presentatie bijwoont van een data-analist die de Belastingdienst toespreekt. De analist legt uit dat je de belastingmoraal van burgers, hoe ze zich straks fiscaal gaan gedragen, kunt voorspellen aan de hand van hun muziekvoorkeuren. ‘Door bijvoorbeeld naar iemands Spotify-playlist te kijken.’

Vandaar dat de data-analist de Belastingdienst adviseert die afspeellijsten op te vragen.

Zulke hongerigheid naar gegevens wordt meestal gezien als een privacyprobleem. Dat is het natuurlijk ook: het is een wezenlijk probleem voor de democratie dat de overheid op grote schaal gevoelige data verzamelt, die niet zelden illegaal worden uitgewisseld, dat wil zeggen, zonder toestemming van de burgers.

Maar naast het privacyprobleem is er nog een ander wezenlijk probleem, namelijk het misplaatste beheersoptimisme dat achter de datahonger zit. De pretentie dat je met een combinatie van data en regels - een combinatie van muziekafspeellijsten en algoritmes – zomaar vanzelf opmarcheert naar het paradijs.

Nieuwe technologie komt altijd met nieuwe beloften, en in het digitale tijdperk beloven bedrijven en overheden ons dat we allemaal zullen profiteren van het superieure management dat met data wordt uitgevoerd. Het leven en de natuur bestaan helemaal uit data, zegt het rationalisme, er zijn geen ongrijpbare fenomenen. Alles is beheersbaar. Alles is voorspelbaar. En alles gaat vooruit.

Bij die claim zijn ook in het digitale tijdperk wel een paar kanttekeningen te plaatsen. Allereerst zou ik zo’n belastingdata-analist met zijn Spotify-afspeellijsten graag het fameuze essay Rational Fools van de econoom Amartya Sen laten lezen.

Dat stamt uit 1977 en ik heb het al vaak aangehaald, maar ik kan het opnieuw niet laten liggen, omdat het met zijn titel zo mooi past in de rationaliteitskritische lijn van Max Weber en Zygmunt Bauman. Ik weet zeker dat Sen tijdens zo’n bijeenkomst bij de Belastingdienst bezwaar zou maken tegen de gedachte dat je het morele gedrag van iemand kunt voorspellen op basis van zijn muziekvoorkeuren. Of ‘haar muziekvoorkeuren,’ zoals Sen zou zeggen.

Sen heeft het in Rational Fools over profilering: hij maakt bezwaar tegen de manier waarop de klassieke economische wetenschap gegevens over gedrag vertaalt in voorkeursordeningen. Zo’n ordening wordt vastgesteld en moet daarna eindeloos veel taken vervullen. Iemand koopt wat, dat komt terecht in haar voorkeursordening, en die ene voorkeursordening, schrijft Sen, moet dan tegelijkertijd haar belangen weerspiegelen, haar welvaart weergeven, haar opvattingen samenvatten over wat er in de toekomst moet gebeuren en haar daadwerkelijke gedrag beschrijven.

Daarmee is het verlangen gelijk geworden aan de keuze, de ambitie gelijk aan de actuele welvaart. Erg informatief is dat niet, zegt Sen. Sterker nog, zo’n geabstraheerd persoon, die geen verschil kent tussen verlangens en keuzes, tussen actuele welvaart en ambities, heeft akelig veel weg van een sociale imbeciel.

Rational Fools heeft bij verschijnen veel stof doen opwaaien, vooral ook omdat de nette professor Sen – de latere Nobelprijswinnaar – in de nette omgeving van de wetenschap zulke krachtige termen durfde te gebruiken als ‘rationele gek’ en ‘sociale imbeciel.’ Maar in een Godwinlezing draaien we onze hand daar niet voor om en ik durf dus best mee te gaan in het taalgebruik. Als je geen onderscheid maakt tussen gedrag in het verleden en in de toekomst, tussen daad en droom, tussen actuele muziekkeuze en morele overwegingen, reduceer je de mens inderdaad tot een imbeciel.

Ik kan het trouwens ook ingetogener zeggen. Computerwetenschapper Jaron Lanier noemt deze gedachte – dat je een mens volledig zou kunnen weergeven met profielen – een filosofische fout. In You Are Not a Gadget (2010) schrijft hij dat je mensen niet kunt reduceren tot de data die je over ze hebt verzameld. ‘Information systems need to have information in order to run, but information underrepresents reality,’ luidt het beroemde citaat. ‘Informatie onderrepresenteert de werkelijkheid.’ Amartya Sen zegt: ‘De rationele types mogen dan de handboeken bevolken, maar de wereld is rijker.’ Nog één stap verder en je zegt: ‘De echte wereld is fundamenteel onvoorspelbaar.’

Dat ik hier zo nadrukkelijk citeer en verwijs, is om te laten zien dat overal volop wordt nagedacht over rationaliseringsprocessen. Al eeuwen waarschuwen mensen uit alle hoeken van wetenschap en praktijk dat de informationele werkelijkheid geen afspiegeling is van de echte wereld. En dat je dus ook het eeuwig durende gesprek over moraal en politiek niet kunt vervangen door de toevallige gegevens die je over mensen op papier zet.

Toch trekt langs de gemeentehuizen en de bestuurlijke congressen tegenwoordig een stoet van verkopers die beloven dat je met datasets de werkelijkheid in handen krijgt. Dat je de complexe morele en politieke worsteling van mensen kunt begrijpen, simpelweg door gegevens te verzamelen over hun aankoopgedrag.

Maar misschien moet ik het de belastingdata-analist met zijn Spotify-afspeellijsten iets makkelijker maken. Niet meteen verwijzen naar een abstracte discussie over filosofische fouten. Eerst eens laten zien wat de beperkingen zijn van data. Het meest praktische probleem is namelijk dat die niet bestaan.

Dat wil zeggen, je treft ze niet in de natuur aan; je kunt ze niet zomaar verzamelen, je moet ze eerst maken. Data zijn zelf al reducties, interpretaties van gedrag. En omdat ze door mensen worden gemaakt, zijn datadefinities dus zelf in veel gevallen politiek gevoelig. Laat ik eerst een paar praktijkvoorbeelden geven, voordat ik iets algemeners zeg.

Data bestaan niet. Zorgen verwarde mensen voor steeds meer overlast en incidenten, zoals je vaak hoort beweren? In De Groene Amsterdammer klinken twijfels. ‘Het is niet vast te stellen of er daadwerkelijk meer incidenten zijn, of dat de politie er door een nieuwe code (code: E33) vanaf 2011 steeds meer is gaan turven.’

Kijk, hier zie je precies hoe willekeurig data zijn: je verandert een code en meteen verandert de interpretatie van het gedrag, en daarmee de gegevens over gedrag. Verzamelen overheden of bedrijven data, dan verzamelen ze geen gedrag, maar interpretaties van gedrag.

En zo gaat dat niet alleen op straat, ook in de schoolklas worden data geproduceerd. Sinds 2015 moeten scholen gedragsincidenten van kinderen registreren. Nu we het tellen en turven volop hebben ontdekt, wordt immers alles onderwerp van belangstelling. Als een kind een petje ophoudt in de klas, kun je dat tegenwoordig als gedragsincident invoeren, maar dan moet iemand dat petje wel eerst in de categorie gedragsincidenten plaatsen. Het is geen gedragsincident: we definiëren en registreren het als gedragsincident.

En alle gebeurtenissen die we niet registreren, blijven buiten beeld.

Nu gaan deze twee voorbeelden over menselijk gedrag, en je zou misschien denken dat een ander soort data minder willekeurig is. Maar kijk eens naar de nieuwprijs van een auto: dat klinkt als een hard en overzichtelijk gegeven en toch verstaat iedere overheidsdienst er weer iets anders onder.

‘Er is in Nederland geen enkele database die exact weet wat de nieuwprijs was van alle gekentekende voertuigen,’ zegt een deskundige op het gebied van kentekenregistratie.* ‘Een gegeven in een registratie is slechts een indicatie van een bepaalde waarschijnlijkheid over wat zich afspeelt in de realiteit’, zegt een gegevensspecialist van de Belastingdienst.

Kortom, data bestaan niet en er bestaat ook niet zoiets als een ‘muziekvoorkeur’. Je kunt beweren dat iemands toekomstige fiscale gedrag er vanzelf uit komt rollen, maar dat is niet zo. Je kunt beweren dat het politieke proces overbodig wordt, omdat alle beslissingen vanzelf uit Big Data rollen, maar zo vanzelf gaat dat niet. Om data te analyseren, moet je ze eerst maken, en de productie van gedragsgegevens is een politiek gevoelige bezigheid. Wie het leven van patiënten, scholieren, belastingbetalers, stadsbezoekers vertaalt in data, kan dat niet waardenneutraal doen. Degenen die de code verzinnen voor ‘petje in de klas’ of ‘overlast op straat’, stoppen hun morele keuzes in die code.

De eerste grote problemen met deze vertaling van gedrag in data komen al aan de oppervlakte. Bij het Openbaar Ministerie bijvoorbeeld. Dat laat in zijn streven naar efficiëntie sinds kort eenvoudige zaken afhandelen door mbo’ers met een computersysteem. Niets ten nadele van mbo’ers, maar ze zijn niet opgeleid voor rechtspreken en dat is hun taak ook niet.

De mbo’ers stoppen gegevens in regels en dan rollen er als door een wonder transactievoorstellen uit: zo kost ‘mishandeling’ twaalf strafpunten à 29 euro. ‘Licht letsel’ erbij kost drie punten extra. Het probleem is natuurlijk dat ‘mishandeling’ en ‘licht letsel’ interpretaties zijn van gedrag en als zodanig vatbaar voor discussie. Daarom kon je ze van oudsher tijdens openbare rechtszaken in alle openheid aanvechten, maar de nieuwe aanpak van de mbo’ers met hun computersysteem is helaas niet openbaar.

In NRC Handelsblad komt strafrechtonderzoeker Joep Lindeman aan het woord: hij heeft promotieonderzoek gedaan naar deze nieuwe vorm van afdoening en hij ontdekte dat officieren in beroepszaken nogal eens schrokken van de resultaten. ‘Soms vonden ze in een dossier geen enkel strafbaar feit.’ Maar Lindeman stelt vast dat de officieren niet van plan zijn te protesteren tegen de gevaarlijke rationalisering van het proces. ‘De strijd tegen de bureaucratie hebben ze opgegeven.’

En ja, dat klinkt bekend, denk je dan in het kader van Godwin. Dienaren van het recht die de strijd tegen de bureaucratie hebben opgegeven: je ziet Zygmunt Bauman hier vol herkenning knikken.

Zo ben ik weer terug bij mijn Godwin van vandaag. Wat zijn de lessen die van de Holocaust te leren zijn?

Als de Holocaust iets heeft aangetoond, zegt Bauman onder verwijzing naar Hannah Arendt, dan is het wel dat de verantwoordelijkheid voor de morele keuze bij de persoon ligt. Individuele mensen moeten in staat zijn zich te verzetten tegen sociale consensus en disciplinering. Tegen profilering en reductie. Ze moeten zelf blijven nadenken over ieder afzonderlijk geval dat zich voordoet en over de regels die zijn gesteld.

Nemen we deze les als uitgangspunt, dan zie ik in het digitale tijdperk al gauw drie opdrachten. Dat wil zeggen: drie problemen met drie suggesties voor een oplossing.

Ten eerste is het nemen van je morele verantwoordelijkheid in dit digitale tijdperk lastig, omdat zoveel zich afspeelt buiten je gezichtsveld en dus buiten je macht. Je kunt het als individu niet makkelijk oneens zijn met onzichtbare krachten. En je kunt morele vooroordelen in data niet aanvechten als je ze niet kent.

Dit eerste probleem vraagt om openheid van data en algoritmes, terugkeer naar de openbare arena, en politiek gesprek. Er zijn heel wat naïeve bestuurders van ziekenhuizen, scholen en bedrijven die hun processen laten sturen door data omdat dat ‘goed’ en ‘beter’ is voor de samenleving – maar volgens wiens definitie? Volgens de datadefinities van de nieuwe wereldmachten Facebook en Google? Over wat goed is, is nu eenmaal niet iedereen het eens.

Het tweede probleem rondom individuele morele verantwoordelijkheid in het digitale tijdperk vloeit voort uit de illusie van kennis en controle. Als rationalisten niet weten hoe de tram werkt, dan denken ze het te kunnen weten, in de woorden van Max Weber. Zo leeft onder bestuurders en beleidsmakers nu de illusie dat ze het gedrag van autonome wapensystemen volledig kunnen beheersen en voorspellen, als ze maar willen. En zolang er maar een ‘human in the loop’ is, is ook de morele verantwoordelijkheid geregeld.

Maar juist experts op het gebied van informatietechnologie manen hier tot bescheidenheid. ‘Denken dat je tijdens het programmeren de complexiteit van het slagveld zo goed kunt voorzien dat je de beslissingen van een wapensysteem van tevoren al kunt uittekenen en kunt spreken van ‘human in the loop’ is pertinent onjuist’, zegt Frank van Harmelen, hoogleraar computerwetenschappen aan de VU. *

Je kunt niet simpel de morele verantwoordelijkheid voor zulke systemen op je nemen vanuit de gedachte dat je wel weet wat ze gaan doen. Dit tweede probleem vraagt om de erkenning dat je de wereld niet geheel kunt beschrijven - dat de informationele werkelijkheid geen kopie is van de echte wereld.

Het derde probleem rondom morele verantwoordelijkheid, ten slotte, gaat over die ‘human in the loop’. Daarvan wordt redding verwacht. Als nog ergens een mens meebeslist met het systeem, is de gedachte, kan er niets misgaan. Maar zo’n human in the loop biedt geen bescherming als die mens is geladen met dezelfde software als het systeem. Met dezelfde moraal als de data.

En dat ligt voor de hand, want de data en de regels en het systeem worden door de mens gemaakt. Voor zover ik me zorgen maak, gaan die zorgen dus over the human in the loop: over de mens die wil beheersen, die de algoritmes schrijft, de systemen ontwerpt, de data definieert, de bestuurlijke oplossingen aanschaft, het juridische proces rationaliseert, de strijd tegen de bureaucratie opgeeft, en die de schoolkinderen aansluit op het internet. Het is allemaal mensenwerk.

Dat is het zorgelijke ervan. Dat is natuurlijk ook het geruststellende ervan. Pas je niet op, en laat je je door abstracties beheersen zonder politieke vragen te stellen, dan loop je met elkaar in ganzenpas op de afgrond af. Maar pas je wel op, dan gebeurt dat niet. Macht houden over je eigen leven, begrijpen dat de wereld onvoorspelbaar is, het onderling oneens zijn over wat goed is: dat tezamen voorkomt veel ellende.

Dit is de uitgeschreven versie van de Godwinlezing die ik op Bevrijdingsdag 2017 uitsprak.