Is programmeren de nieuwe geletterdheid?

‘Programmeren is de nieuwe geletterdheid’, stelt Gaël Varoquaux in een Amsterdams café. Ik in een natgeregende spijkerbroek, hij in een rode outdoorbroek.

Ik heb geluk dat ik Varoquaux in levende lijve kan ontmoeten. Op het moment is de Franse computerwetenschapper op sabbatical in Montreal, maar hij is toevallig in Amsterdam voor een congres.

Varoquaux is een van de grondleggers van scikit-learn, een machine learning-pakket in Python, de populairste programmeertaal van dit moment. Het heeft op dit moment bijna één miljoen unieke bezoekers per maand. Als ik hem vraag wat je met het pakket kunt doen, zegt hij: ‘Alle machine learning behalve deep learning.’

Dat is apart, want deep learning is de hype van dit moment. Google Translate, Siri, Spotify... allemaal maken ze er gebruik van. Deep learning draait om neurale netwerken, vaak ingewikkelde rekensystemen die veel data en rekentijd vergen.

Dat is nu net het probleem. De enorme datasets die je nodig hebt, liggen vaak bij de grote bedrijven. Daarbij is het trainen van een deep learning model vaak ook nog eens peperduur.

Daarom biedt scikit-learn machine learning die toegankelijker is. ‘Data science for the many, not the mighty’, stelt Varoquaux. Niet alleen grote bedrijven moeten kunnen innoveren, vindt hij, maar iedereen. Anders blijven belangrijke vragen liggen.

Het pakket is dan ook open source, maar – belangrijker nog – Varoquaux en collega’s doen hun best om het zo gemakkelijk mogelijk te maken. Bijvoorbeeld voor artsen, stelt Varoquaux, die zelf computerwetenschap toepast op de geneeskunde. ‘Zij zijn heel slim, zij kunnen het heus wel leren.’

Ik ben wel benieuwd: Heb jij weleens met scikit-learn gewerkt? Wat vind je ervan? En, algemener, wat vind je van het idee dat programmeren de nieuwe geletterdheid is? Ik hoor het graag in de bijdragen.

COMPAS

Dat computermodellen bevooroordeeld kunnen zijn, is al langer bekend. Een van de artikelen die dit probleem op de kaart hebben gezet is ‘Machine Bias’ van ProPublica. Journalisten lieten daarin zien dat COMPAS, software voor het voorspellen van recidivisme, zwarte verdachten anders beoordeelde dan witte.

Van Afro-Amerikanen werd vaker verwacht dat ze weer in de fout zouden gaan dan van witte Amerikanen. Dat klopte niet met de werkelijkheid, volgens ProPublica: van degenen die niet meer in de fout gingen, waren twee keer zo veel zwarte Amerikanen als ‘hoog risico’ aangeduid als witte.

Journalisten lieten zien dat COMPAS, software voor het voorspellen van recidivisme, zwarte verdachten anders beoordeelde dan witte

Maar hoe moet het dan wel? Op die vraag gaan Karen Hao en Jonathan Stray in in een nieuw artikel in de MIT Technology Review. In een spel laten ze je kiezen wat als ‘hoog’ en ‘laag’ risico zou moeten gelden.

Al snel zie je dat dit een duivels dilemma is. Óf je legt de grens op dezelfde plek voor witte en zwarte Amerikanen en je benadeelt de laatste groep. Óf je legt de grenzen voor de twee groepen op verschillende plekken, maar daarmee discrimineer je alsnog en dat is misschien ook nog eens ongrondwettelijk.

Rechters zijn ook niet ideaal, ook zij hebben vooroordelen. Alleen, schrijven Hao en Stray, hen kun je in ieder geval verantwoordelijk houden voor hun beslissing. COMPAS, daarentegen, is in bezit van het bedrijf Northpointe dat het algoritme als bedrijfsgeheim beschouwt.

Het is een mooie verkenning van de netelige kwesties rondom rechtvaardigheid. Hao en Stray sluiten af met een citaat van hoogleraar Rechtsgeleerdheid Andrew Selbst:

‘Telkens als je filosofische ideeën van rechtvaardigheid in wiskundige uitdrukkingen wilt gieten, dan raken ze hun nuance, hun flexibiliteit, hun kneedbaarheid kwijt. Daarmee wil ik niet zeggen dat een deel van de efficiëntie ervan uiteindelijk niet waardevol zal zijn. Ik heb alleen mijn twijfels.’

Tot slot...

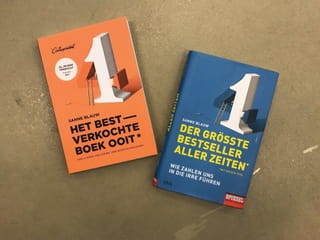

...is mijn boek er nu ook auf Deutsch: Der größte Bestseller aller Zeiten (mit diesem Titel).